Experten fordern einen Stopp der weiteren Entwicklung der künstlichen Intelligenz. Was treibt sie dazu an?

Künstliche Intelligenz hat in letzter Zeit einen enormen Aufschwung erlebt. Alle sind von dieser Technologie so begeistert, dass sie sich der Risiken, die in Zukunft auftreten könnten, gar nicht bewusst sind. KI-Experten schlagen derzeit Alarm und warnen, dass Unternehmen sich mit den Risiken befassen sollten, bevor es zu spät ist.

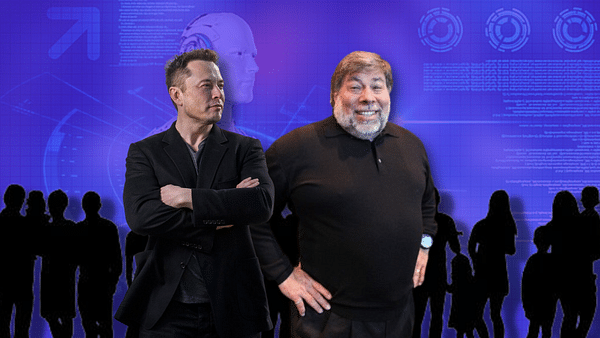

In einem kürzlich veröffentlichten offenen Brief mit dem Titel "Pause Giant AI Experiments: An Open Letter" fordern Experten für künstliche Intelligenz (KI) die in diesem Bereich tätigen Unternehmen auf, die Entwicklung generativer KI-Systeme vorübergehend einzustellen. Der Brief, der von mehr als 1.000 Personen unterzeichnet wurde, darunter Elon Musk, Steve Wozniak, Evan Sharp, Craig Peters und Yoshua Bengio, verweist auf die Ungewissheit über die möglichen künftigen Auswirkungen der Ergebnisse dieser Entwicklungen.

In dem Schreiben schlagen die Experten eine sechsmonatige Pause vor, um Regulierungsrichtlinien und -verfahren zur sicheren Weiterentwicklung der KI-Technologie zu entwickeln. Die Pause sollte nur für das Training von KI-Systemen gelten, die leistungsfähiger sind als GPT-4, das von OpenAI entwickelte generative KI-Modell. Sollte der Aufruf der Experten nicht befolgt werden, schlägt der Brief vor, dass die Regierungen ein Moratorium verhängen.

Zu den Unternehmen, die in die Entwicklung generativer KI und verwandter Technologien investieren, gehören Giganten wie Microsoft $MSFT+0.1%, Alphabet $GOOGL-1.5%, Alibaba $BABA-0.9% und Baidu $BIDU-0.4%. In dem Schreiben der Experten werden Sicherheitsprotokolle und die Gewährleistung positiver Auswirkungen und der Beherrschung von Risiken gefordert. Das Ergebnis des Schreibens könnte dazu führen, dass die Unternehmen entweder aufhören und neue Strategien formulieren oder zumindest über die potenziellen Auswirkungen nachdenken und die erforderlichen Maßnahmen ergreifen.

GPT-4 als Auslöser für potenzielle Probleme

Das vor kurzem eingeführte GPT-4 hat die Benutzer mit seinen Fähigkeiten bei der Konversation, dem Verfassen von Liedern und der Zusammenfassung langer Dokumente beeindruckt. Die Reaktion auf dieses Modell hat Wettbewerber wie Alphabet Inc. dazu veranlasst, die Entwicklung ähnlicher großer Sprachmodelle zu beschleunigen. KI-Experten fordern jedoch eine Verlangsamung der Entwicklung, bis wir die Auswirkungen und den möglichen Schaden für die Gesellschaft besser verstehen.

Das Future of Life Institute, eine gemeinnützige Organisation, die vor allem von der Musk Foundation, der in London ansässigen Founders Pledge Group und der Silicon Valley Community Foundation finanziert wird, vertritt in einem offenen Brief die Auffassung, dass leistungsstarke KI-Systeme nur dann entwickelt werden sollten, wenn wir sicher sind, dass ihre Auswirkungen positiv und ihre Risiken überschaubar sind. Die Organisation fordert außerdem eine Regulierungsbehörde, die sicherstellt, dass die Entwicklung von KI dem öffentlichen Interesse dient.

Elon Musk, Mitbegründer von OpenAI und einer der Experten, die das Schreiben unterzeichnet haben, ist bekannt für seine Warnungen vor den potenziellen Risiken der KI-Entwicklung. Er sagt, es sei wichtig, gemeinsame Sicherheitsprotokolle zu erstellen, die von unabhängigen Experten entwickelt werden, und fordert die Entwickler auf, mit den politischen Entscheidungsträgern an der Governance zu arbeiten.

Der geschäftsführende Direktor von OpenAI, Sam Altman, und die CEOs von Alphabet und Microsoft, Sundar Pichai und Satya Nadella, gehörten nicht zu den Unterzeichnern des offenen Briefes. Nichtsdestotrotz stellt der Brief einen wichtigen Schritt zur Eröffnung einer Diskussion über die Zukunft der KI und die damit verbundenen potenziellen Risiken dar.

Mögliche Auswirkungen des Briefes

Es gibt mehrere mögliche Auswirkungen, die sich aus dem Brief ergeben können. Eine davon ist, dass Unternehmen und Forschungseinrichtungen, die an der Entwicklung von KI beteiligt sind, ihre Aktivitäten vorübergehend einstellen und ihre Praktiken überdenken könnten. Dieses Szenario würde es Experten und Regulierungsbehörden ermöglichen, die bisherigen Entwicklungen zu überprüfen und die notwendigen Maßnahmen zu ergreifen, um Sicherheit und Nachhaltigkeit im Bereich der KI zu gewährleisten.

Alternativ dazu könnte der Brief zu einem größeren Bewusstsein für die potenziellen Risiken im Zusammenhang mit der KI-Entwicklung und für die Notwendigkeit der Einführung von Sicherheitsprotokollen und Regulierungsverfahren führen. Dies würde es den Unternehmen ermöglichen, sich stärker auf die Entwicklung sicherer und ethisch vertretbarer KI-Systeme zu konzentrieren, die einen positiven Einfluss auf die Gesellschaft haben.

Schließlich könnte das Schreiben Regierungen und internationale Organisationen dazu anregen, die Einführung von Regulierungsmaßnahmen und Moratorien für die KI-Entwicklung zu erwägen. Dies würde sicherstellen, dass die KI-Entwicklung im Einklang mit den Interessen der Gesellschaft erfolgt und mögliche negative Auswirkungen minimiert werden.

Unabhängig vom Ergebnis des offenen Briefes ist klar, dass die Debatte über die Sicherheit und Ethik der KI-Entwicklung immer dringlicher wird. Da KI-Systeme wie das GPT-4 im Alltag immer allgegenwärtiger werden, muss man sich darauf konzentrieren, wie diese Technologien zum Wohle der Gesellschaft eingesetzt werden können, ohne die Privatsphäre, die Sicherheit oder die Interessen des Einzelnen zu gefährden.

Ein Beispiel, das zeigt, wie KI-Systeme zum Wohle der Allgemeinheit eingesetzt werden können, ist die Verwendung von GPT-4 zur Lösung von Umwelt-, Gesundheits- oder Wirtschaftsproblemen. Andererseits müssen auch mögliche Risiken berücksichtigt werden, wie der Missbrauch der Technologie zur Verbreitung von Fehlinformationen, zur Manipulation der öffentlichen Meinung oder zur Vergrößerung der Ungleichheit beim Zugang zur Technologie.

Der offene Brief "Pause Giant AI Experiments" ist ein Aufruf zum Nachdenken über den Weg, den die KI-Entwicklung nehmen wird. Ob ein Konsens zwischen Experten, Unternehmen und Regierungen erreicht werden kann, bleibt eine Frage. Es ist jedoch wichtig, dass sich Wissenschaftler, Branchenführer und politische Entscheidungsträger auf die Zusammenarbeit konzentrieren, um Wege zur Sicherung und Regulierung der KI-Entwicklung zu finden, die im besten Interesse der Menschheit sind.

WARNUNG: Ich bin kein Finanzberater, und dieses Material dient nicht als Finanz- oder Anlageempfehlung. Der Inhalt dieses Materials ist rein informativ.